OpenAI 的「职工逃窜」还莫得末端万博客户端app下载。

近日,OpenAI 又有一位 6 年元老、筹商旁边 Miles Brundage 发表长文吏宣下野,并详确解说了我方为何「出走」。

行动一家年青的 AI 独角兽,劝诱于 2015 年的 OpenAI 如今刚刚 9 岁,因此在公司待了 6 年之久的 Brundage 足以被称为「元老」,见证了 OpenAI 何如一都调养、筚路褴褛地走到今天。

在博文中,Brundage 也在发轫强调:为 OpenAI 的高管和董事会提供建议,为 AGI 的到来作念准备,这本色上是他逸想中的责任;以致就在 2015 年 OpenAI 刚劝诱时,Brundage 振作得整夜不睡,写下一篇博文强调这个组织的紧要性。

原文地址:https://www.milesbrundage.com/blog-posts/archives/12-2015

因此,离开 OpenAI 对他来说并不是一个容易的决定。关联词为了有更多时辰筹商我方以为紧要的课题,更落寞、目田地发表不雅点和作品,Brundage 决定转而加入(以致我方创办)非牟利组织,将重心放在 AI 战术筹商和见识上。

Miles Brundage 本科毕业于乔治华盛顿大学,本科时间担任过好意思国动力部的迥殊助理,之后前去亚利桑那州立大学攻读博士,筹商宗旨为科技的东说念主类和社会维度,博士后时间曾在牛津大学担任 AI 战术筹商员。

2018 年,Miles Brundage 加入了刚刚劝诱 3 年的 OpenAI 担任战术方面的筹商科学家,之后又在 2021 年升任筹商旁边,目下是 AGI 准备责任的高等照管人。

为何离开 OpenAI

总体来看,Brundage 的下野是但愿从行业外部而非里面影响 AI 的发展,这与本年 Geoffrey Hinton 离开谷歌的原因如出一辙,具体有如下几个接头身分:

契机资本

本职责任依然占去了险些全部的时辰,因此 Brandage 嗅觉很难从事我方以为紧要的筹商课题。以致在某些情况下,身处行业除外时,从事这些筹商能更有影响力和劝服力。

而且,OpenAI 目下依然如斯引东说念主慎重,效果发布前就需要从许多不同的角度进行审查,以至于无法发表某些主题的著述。

但值得留意的是,Brundage 并不是完全反对 OpenAI 在出书物审查方面的态度,他以为行业中存在出书末端是合理的,他本东说念主也匡助编写了 OpenAI 战术的几个迭代版块,但公司目下施加的末端照实依然太多了。

减少偏见

如若选择成为某个组织的一部分,而况每天都和那里的共事们密切合营,你就很难对这个组织保合手公道。

Brundage 表示,他在分析中竭力于追求公道,但仍然会有偏见的存在。而且在 OpenAI 责任这件事自己,就会影响到外界何如看待我方的不雅点和筹商。接头到财务利益上的突破,东说念主们有事理质疑来自行业的战术想法。

在关连战术的对话中,有更多落寞于行业的声息至关紧要,而 Brundage 筹商成为其中之一。

在 OpenAI,能作念的都作念了

从入职于今,Brundage 以为我方行动「AGI 准备景象高等照管人」的责任依然完成了大部分。

「AGI 准备景象」(AGI Readiness)主要分为两种:一是 OpenAI 要准备好治理日益浩大的 AI 才能,二是统共寰宇也要准备好有用治理 AI 才能,包括通过监管 OpenAI 和其他公司。

关于前者,Brundage 依然向他的负责对象—— OpenAI 的高管和董事会——详确先容了他以为 OpenAI 需要作念什么,以及差距在那边;而关于后者,他以为我方在 OpenAI 外部能够愈加有用。

天然失去了一些在 OpenAI 阐扬影响力的契机,但 Brandage 但愿在更猛经由上影响统共生态系统。

AGI,咱们都没准备好

Brundage 以为,关于行将到来的 AGI,OpenAI 或任何其他的前沿本质室都还莫得准备好,这个寰宇也还莫得准备好。

原文地址:https://medium.com/@miles_24227/scoring-humanitys-progress-on-ai-governance-5a5131cb84c7

但需要明确的是,他不以为这种「没准备好」的景象与 OpenAI 率领层的声明相突破;同期他也示意,天然距离逸想的法式存在相当的差距,关联词咱们仍不错在联系时辰点步入正轨,为此 Brundage 将在余下的工作生存中接力于于东说念主工智能战术。

科技公司和这个寰宇是否走上了 AGI 准备的正轨,是一个复杂的函数,取决于安全和保险方面的文化何如跟着时辰的推移而阐扬作用、监管何如影响组织的激勉步调、多样关连 AI 才能和安全方面贫苦的事实,以及多样其他身分。

此处,Brundage 迥殊表扬了 OpenAI 最近新加多董事会成员的决定,新吸纳的成员包括前陆军上将 Paul M. Nakasone 和 CMU 机器学习系主任 Zico Kolter,这都是朝着正确宗旨迈出的一步。

趁机一提,Brundage 表示,「AGI」这个术语承载了太多兴味,它当今更多地示意着一种二元想维方式,而不是本色兴味,因此有必要领会一下,此处的「为 AGI 作念好准备」,指「准备好安全、可靠且有利地劝诱、部署和治理才能日益浩大的 AI 系统」。

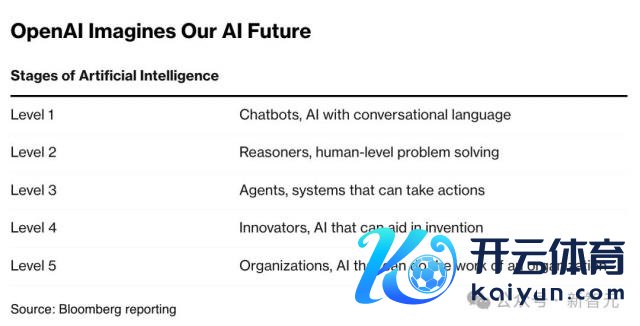

最近,他和团队正在充实 OpenAI 建议的 AGI 五级框架,不久后省略会发表一篇郑重的论文。这个框架曾被彭博社透露,引来了不少争议。

天然 Brundage 对 AI 战术抱合手着严慎和批判的魄力,但关于 AGI 远景的瞻望,他确切称得上是一个「手艺乐不雅主义者」,不雅点与硅谷的风投大佬 Khosla 额外一致。

他以为,在异日短短的几年内,东说念主工智能很可能能够杀青宽裕的经济增长。假定咱们能制定出妥当的战术来确保公道分派,东说念主类就能杀青高生流水平的提前退休。

但在此之前的短期时辰中,AI 很可能会抢走一些遑急需要责任的东说念主的契机,尤其是那些不错资料完成的、容易自动化的任务。

但事实是,东说念主类最终应该解脱为营生而责任的义务,这也为构建 AI 和 AGI 提供了最强有劲的论据之一。从永久来看,有些东说念主可能会连接责任,但不会像当今这么有如斯遑急的激勉身分。

一个「后责任寰宇」(post-work world)的风险之一等于斯文的停滞(比如电影「机器东说念主总动员」所展现的),但咱们目下还莫得在政事、文化或其他方面为此作念好准备,因此需要更多的想考、辩白和战术议论。

2008 年电影「机器东说念主总动员」(WALL-E),由皮克斯责任室制作、迪士尼出品

许多东说念主都形容过「AI 造福东说念主类」的远景,这些形容似乎是出于好意而非贪心论。但目下存在效力低下的问题,很猛经由上是由于民间社会和政府的手艺专科学问不及,以及穷乏讲究的范例和表面基础。

举例,关于出现的问题,咱们是否应该守望阛阓机制给出处置样式?什么时候应该构建定制化、诈欺规模狭小的 AI 处置有运筹帷幄,什么时候应该擢升通用 AI 系统的才能来处置?在多样情况中,正确的样式是连接补足现存的手艺,如故创造全新的手艺,等等。

要不要在 OpenAI 责任

「要不要在 OpenAI 责任」,这个问题听起来有点凡尔赛,不错类比下「斯坦福和 MIT 该选哪个」。

但如若屏幕前的你拿到了 offer 正在纠结该去 OpenAI 如故谷歌 DeepMind,Miles Brundage 的教育省略能匡助你处置这个甘好意思的郁闷。

在 OpenAI 责任是大遍及东说念主但愿能作念到的最有影响力的事情之一,是以在大遍及情况下,谜底是服气的。

接头到每个东说念主领有的手段和契机不同,很难作念出疲塌的述说,但有少量是细目的—— OpenAI 的每一个扮装,以及每个东说念主对待责任的严慎经由都很紧要,对 OpenAI 组织文化的每一项孝敬也很紧要。

在通往更浩大 AI 的说念路上,每一次产物的部署都会阐扬紧要作用,比如影响行业范例,以及东说念主们领路和监管 AI 的方式。

在 OpenAI 责任,不管是 AI 的安全与保险,抑或是 AI 才能和产物方面的筹商,阐扬个东说念主的能动作用来股东 AI 安完全瑕瑜常有影响力的。

底下这段话,似乎是 Brundage 的一段隔空喊话,写给他仍在 OpenAI 责任的前共事们:

「任安在 OpenAI 责任的东说念主都应该崇敬对待这么一个事实:他们的举止和言论有助于组织文化,而况当这个组织驱动掌管极其先进的才能时,可能会创造正面或负面的旅途依赖。文化对任何组织都很紧要,但在前沿 AI 的布景下尤其紧要,因为大部分决策不取决于监管划定,而是来自公司中的东说念主。」

正如 Brundage 在前文所表示的,他以为某些战术筹商最佳在外部进行,AI 的安全和保险责任未必亦然如斯。尽管 OpenAI 里面照实需要一些东说念主来股东公司接受讲究的战术态度,但存在落寞的安全筹商也很有价值。

参考云尔

https://milesbrundage.substack.com/p/why-im-leaving-openai-and-what-im

https://www.reddit.com/r/singularity/comments/1gagocj/openai_senior_advisor_for_agi_readiness_leaving/万博客户端app下载